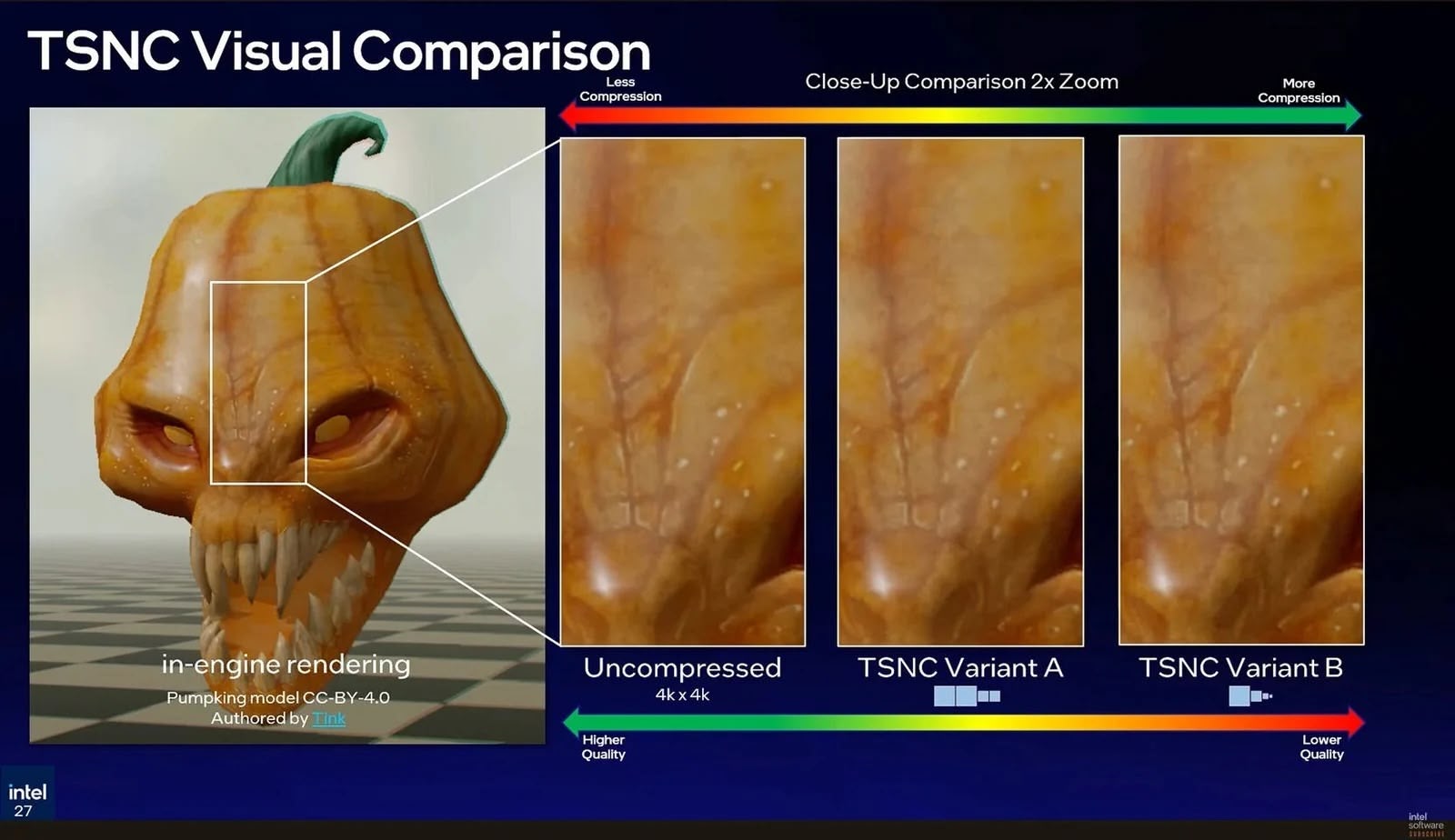

La GDC 2026 aura été celle de la compression neuronale. Après NVIDIA et sa technologie NTC capable de réduire l’empreinte VRAM de 85 %, c’est Intel qui a détaillé sa propre solution. Elle s’appelle TSNC, pour Texture Set Neural Compression. Le principe : au lieu de compresser chaque texture séparément, un réseau de neurones traite un ensemble complet de textures comme un seul bloc d’optimisation.

Variante A ou Variante B : qualité ou compression maximale

Intel propose deux modes. La Variante A atteint un ratio de compression de 9x par rapport au format standard BCn. La perte visuelle est estimée à 5 % selon l’outil FLIP de NVIDIA. La Variante B pousse le curseur à 18x, soit quatre fois mieux que la compression par blocs classique. Le coût : environ 6 à 7 % de perte perceptuelle et quelques artefacts visibles.

En pratique, la différence se traduit ainsi. Un jeu comme Hogwarts: Legacy pèse 58 Go, auxquels s’ajoutent 18 Go de pack de textures HD. Avec un ratio 18x sur les textures, ce pack tomberait à environ 1 Go. Point important en cette période de disette numérique : le gain touche aussi la VRAM. NVIDIA a montré une scène passant de 6,5 Go d’occupation mémoire à 970 Mo avec sa propre NTC. En pleine crise des prix de la RAM, l’argument n’est pas anodin. L’IA qui règle un problème qu’elle a crée, c’est tout de même cocasse.

La technologie TSNC fonctionne à plusieurs niveaux. Elle peut intervenir à l’installation pour réduire la taille sur le disque. Elle peut aussi décompresser les textures en temps réel pendant le jeu. Sur un GPU Intel Panther Lake avec cœurs XMX, le décodeur produit son premier pixel en 0,194 nanoseconde. Intel prévoit aussi un mode de repli par multiplication-addition fusionnée, compatible avec d’autres GPU, mais trois fois plus lent.

Le véritable enjeu : un standard commun ou trois solutions propriétaires

Le SDK d’Intel arrivera en version alpha « plus tard cette année ». Celui de NVIDIA est déjà disponible. Microsoft travaille de son côté sur l’intégration dans DirectX via les Cooperative Vectors. Mais pour l’instant, chaque constructeur pousse sa propre cuisine, à l’instar des chantiers sur la gestion des shaders. Intel utilise une pyramide BC1 à quatre niveaux et un décodeur MLP à trois couches. NVIDIA passe par ses Tensor Cores.

Le risque est celui des upscalers : trois technologies concurrentes, adoption fragmentée, et des développeurs qui attendent de voir qui gagne avant de s’y mettre. La différence, c’est que Microsoft semble vouloir fédérer les approches via DirectX. Si un standard émerge, la compression neuronale pourrait devenir aussi banale que le DLSS en quelques années. En attendant, les 108 Go de la démo Zorah de NVIDIA rappellent à quel point le problème est urgent.

👉🏻 Suivez l’actualité tech en temps réel : ajoutez 01net à vos sources sur Google, et abonnez-vous à notre canal WhatsApp.

Source : Intel (Youtube)