Nouvel épisode dans la polémique qui entoure le projet de loi européenne visant à lutter contre les contenus pédopornographiques, le projet de règlement CSAR (« Child sexual abuse regulation »). Les logiciels de l’ONG Thorn, mis en avant par la Commission européenne pour détecter ce type de vidéos ou d’images, ne seraient pas aussi efficaces et fiables que prévu.

C’est ce que montre Follow the Money, une plateforme de journalisme d’investigation indépendante, dans un article du jeudi 25 janvier. La controverse avait débuté en mai 2022, date de publication du projet de règlement par la Commission européenne. Le texte, qui vise à davantage protéger les enfants et les mineurs sur le Web et les réseaux sociaux, imposerait à toutes les plateformes, y compris les messageries chiffrées comme WhatsApp ou Signal, une nouvelle obligation de détecter des contenus pédopornographiques.

Et jusqu’à présent, les logiciels de Thorn, l’ONG fondée par les acteurs Demi Moore et Ashton Kutcher, étaient cités par la Commission européenne comme des solutions techniques adéquates. Dans son évaluation d’impact – un document en annexe du projet de règlement – l’exécutif européen présente ainsi les outils de Thorn comme « un exemple de la capacité de l’industrie à détecter du contenu pédopornographique ».

Le cas des « faux positifs »

Mais selon Follow the Money, la technologie de Thorn serait bien moins fiable qu’elle ne le prétend. Nos confrères expliquent s’être basés sur différents éléments : des documents internes de la Commission européenne, non publiés et obtenus via une demande d’accès déposée auprès du gouvernement suédois, des pièces provenant de Thorn, et des déclarations de la lobbyiste de cette ONG.

Ainsi, un document provenant de la Commission européenne, intitulé « Atténuation des faux positifs », préciserait que le logiciel de Thorn, loin d’être un outil technique miracle, identifierait à tort des images comme étant du contenu pédopornographique dans 0,1 % des cas. En d’autres termes, une image sur mille serait ce qu’on appelle un faux positif. « Une image sur mille, signalée à tort, cela peut sembler être peu », explique à nos confrères Kris Shrishak, de l’Irish Civil Liberties Council, une ONG irlandaise militant pour les libertés civiles et les droits humains. Mais avec des millions de photos échangés quotidiennement, le chiffre serait loin d’être négligeable, explique le spécialiste. 0,1% représenterait en fait des milliers de faux positifs, qui seraient détectés à tort chaque mois.

Dans ce document, la Commission européenne cite également des tests effectués sur le logiciel de Thorn, précisent nos confrères. Selon ces évaluations, la technologie de Thorn fonctionnerait relativement bien sur des photos et vidéos déjà identifiées comme étant pédopornographiques par la police. Ces dernières seraient ensuite retrouvées sur des plateformes ou des messageries par le logiciel. Mais l’outil de Thorn « ne détecterait pas de manière exhaustive les nouveaux contenus d’abus sexuels commis sur des enfants », est-il écrit, soit ceux qui n’ont pas été préalablement identifiés par les services de police.

Inefficace sur les conversations chiffrées ?

Un autre document, rédigé par la lobbyste de Thorn, Emily Slifer, en février 2022, et cité par nos confrères, vient battre en brèche une autre promesse de Thorn : celle d’avoir développé des solutions aussi efficaces sur les messageries chiffrées. Le texte, fourni par les autorités suédoises, n’aurait cependant pas été partagé avec la Commission européenne. Il y est écrit noir sur blanc que « la technologie actuelle de chiffrement de bout en bout rend impossible la détection, la suppression et le signalement de contenus pédopornographiques ».

En d’autres termes, écrivent nos confrères de Follow the Money, l’ONG reconnaissait, en 2022, que son logiciel n’était pas capable de détecter ce type de textes, d’images ou de vidéos dans les conversations chiffrées de bout en bout. Pourtant, quelques mois plus tard, le fondateur de Thorn, Ashton Kutcher, vantait devant le Parlement européen l’utilisation de cette technologie « sans jamais regarder l’image », grâce à la méthode de « chiffrement homomorphe ». Cette technique permettrait de scanner des données chiffrées sans que celles-ci aient à être déchiffrées – ce qui, théoriquement, permettrait de ne pas casser le chiffrement. Or selon le document datant de février 2022, la solution technique proposée par Thorn ne serait tout simplement pas encore applicable à grande échelle.

Interrogée par nos confrères début 2024, la lobbyiste de l’ONG, Emily Slifer, a confirmé que « la technologie de Thorn ne fonctionne pas dans les espaces chiffrés ». Selon cette dernière, « il n’existe pas encore de solutions efficaces pour détecter les contenus pédopornographiques dans les environnements chiffrés. Mais nous sommes convaincus, grâce à notre expérience approfondie dans le domaine de la technologie, que de telles solutions existeront un jour ».

La Commission européenne pourrait publier ses communications avec Thorn

Depuis des mois, les défenseurs et pourfendeurs de ce type d’outils de détection s’opposent. D’un côté, certains estiment que cette technologie, promue par Thorn, pourrait conduire à une surveillance de masse. Le Contrôleur européen de la protection des données, dans un séminaire dont nous nous faisions l’écho en octobre dernier, avait fait appel à plusieurs spécialistes dont les conclusions se rejoignaient. Une telle obligation de détection sur toutes les messageries ne permettrait pas de lutter contre les abus sexuels sur les enfants. La mesure serait, en plus, dangereuse pour nos libertés fondamentales, plaidaient les experts.

À lire aussi : Imposer la détection de contenus pédopornographiques serait aussi inefficace que nuisible, selon des experts

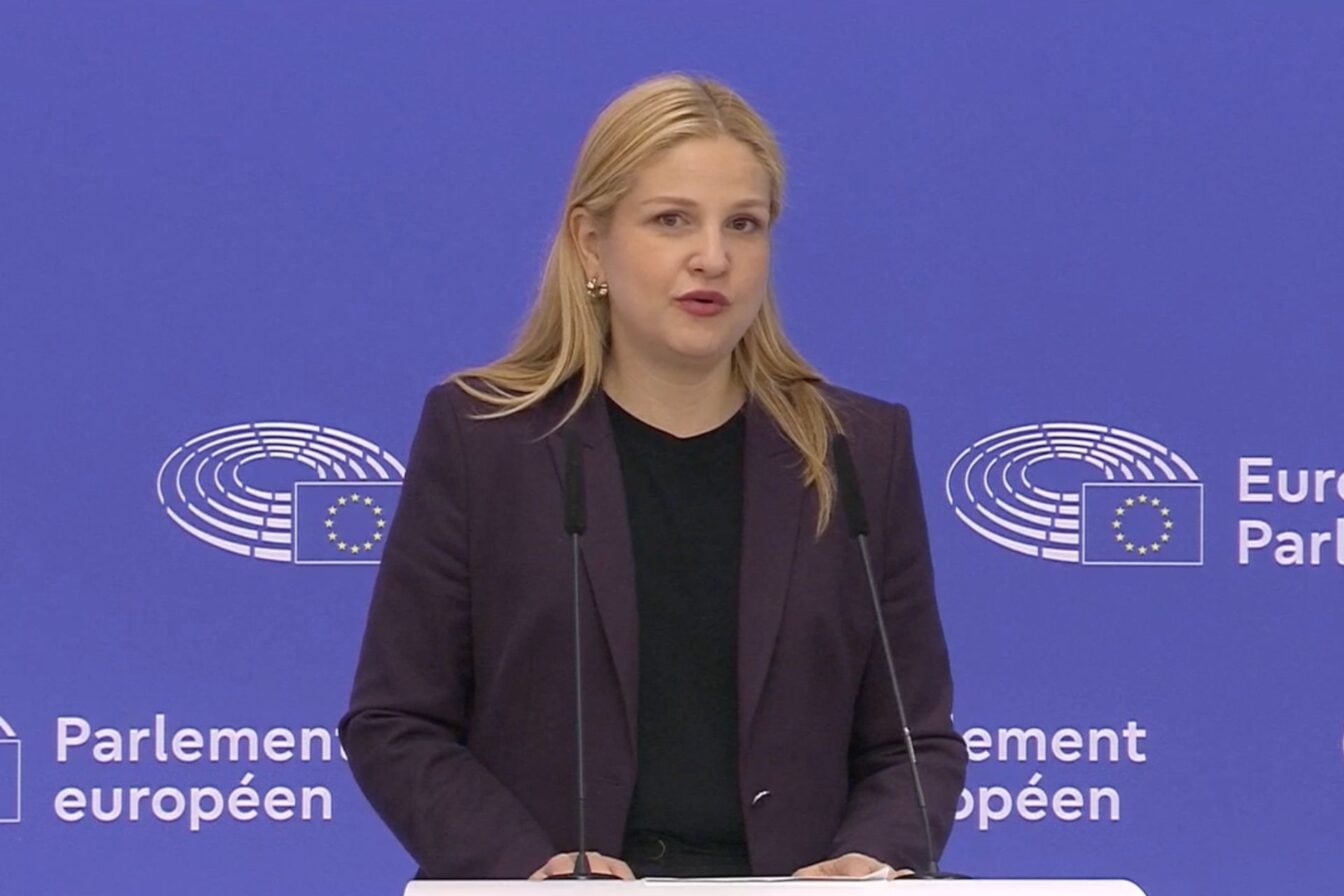

Mais d’autres – comme YIva Johansson, la commissaire européenne en charge des Affaires intérieures à l’origine du texte – estiment que la mise en place de ces nouvelles obligations permettrait de mieux protéger les mineurs des prédateurs sexuels sur les réseaux sociaux et les messageries.

Cette nouvelle affaire s’ajoute à la polémique qui entoure les relations alléguées entre la Commission et Thorn. L’exécutif européen est accusé d’avoir été influencé par des organisations comme Thorn, qui aurait poussé à la mise en place d’une telle proposition de règlement.

À lire aussi : Scanner les messageries chiffrées pour lutter contre la pédopornographie : des lobbys industriels derrière la future loi européenne ?

Car si le règlement finit par être adopté, la détection deviendrait obligatoire, et les principales intéressées (les entreprises développant ce type de logiciels) seraient les principales bénéficiaires de la mesure. Elles seraient en première ligne pour vendre leur technologie aux messageries concernées. Afin de lever le voile sur ces accusations, des médias avaient demandé à la Commission européenne de publier la totalité des communications entre Bruxelles et cette ONG – en vain.

Pour autant, l’exécutif pourrait être contraint à davantage de transparence. Le 19 décembre dernier, le médiateur de la Commission européenne a recommandé à cette dernière de « reconsidérer sa décision (de refus de publication, NDLR) en vue d’accorder au public un accès nettement plus large, voire total, aux documents en question », peut-on lire dans la préconisation. Depuis des semaines, aucun consensus ne se dégage du projet de règlement CSAR. Mais le rythme des négociations pourrait s’accélérer. La présidence belge du Conseil de l’UE, débutée début janvier, espère trouver un consensus entre les 27 États membres d’ici le début du mois de mars.

👉🏻 Suivez l’actualité tech en temps réel : ajoutez 01net à vos sources sur Google, et abonnez-vous à notre canal WhatsApp.

Source : Follow the money