Après l’expérimentation, la mise en pratique. Facebook va généraliser à l’ensemble de ses utilisateurs la détection des comportements suicidaires par le biais d’une intelligence artificielle, selon Mark Zuckerberg. Seule partie du monde non concernée : l’Union européenne. Ici, le système de profilage automatisé y est clairement interdit par la « general data protection regulation » (GDPR) qui s’appliquera dès 2018.

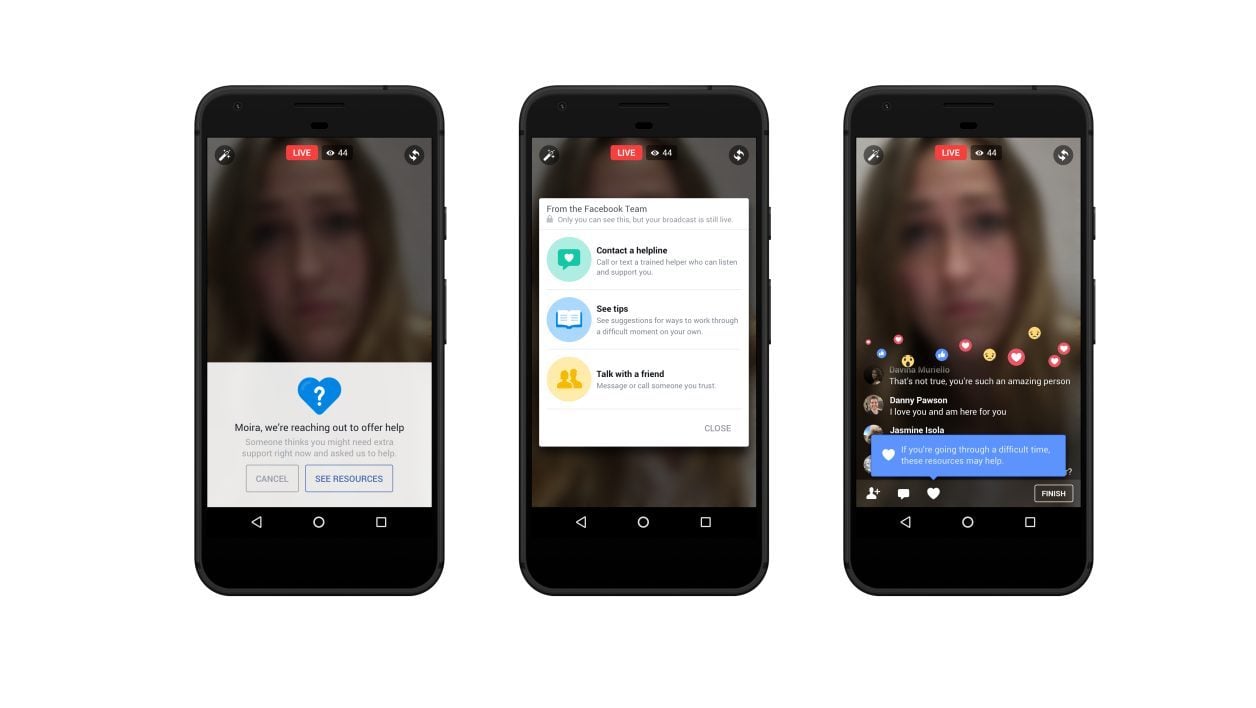

Le système, s’il part d’une bonne intention, est toutefois intrusif. Il détecte les publications contenant des termes appartenant au champ lexical du suicide ; cela aussi bien par écrit qu’en vidéo. Si lors d’un Facebook Live, l’utilisateur exprime une quelconque volonté de suicide, un pop-up surgira pour proposer de l’aide. Il pourra parler directement à un ami, lire des conseils ou joindre une assistance prodiguée par plusieurs associations partenaires à travers le monde.

Pour y parvenir, l’intelligence artificielle a été entrainée à reconnaître certains mots et tournures de phrases. Et si l’utilisateur ne s’exprime pas clairement, elle sait aussi repérer le type d’images qu’une personne pensant au suicide peut publier sur son profil.

Et si l’IA servait à autre chose ?

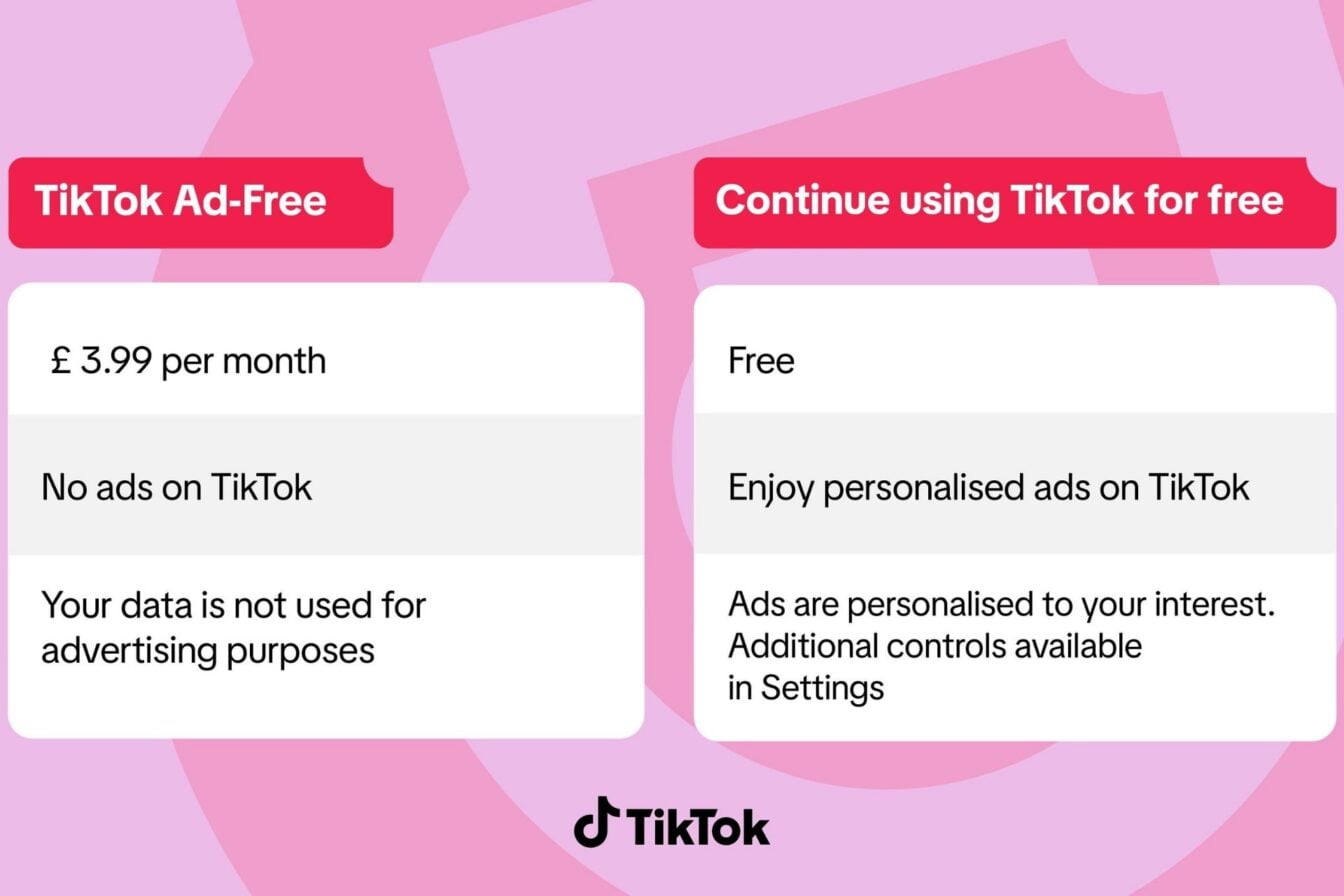

Il n’est pas difficile d’imaginer la situation si le système était utilisé à des fins de censure ou d’établissement de profils publicitaires encore plus fins. Face à cette interrogation soulevée sur Twitter par un journaliste de TechCrunch, Alex Stamos, chef de la sécurité de Facebook, répond que l’utilisation malicieuse de l’intelligence artificielle sera « toujours un risque ». Il précise toutefois qu’il est important de « mettre au point de bonnes normes aujourd’hui » pour éviter cela.

https://twitter.com/alexstamos/status/935184558797889536

Reste la question du consentement. Rien ne permet en effet aux utilisateurs de Facebook de désactiver cette nouvelle fonctionnalité. Européens mis à part, les utilisateurs du réseau social seront donc obligés d’accepter qu’une intelligence artificielle scanne automatiquement tous les contenus qu’ils auront publiés.

👉🏻 Suivez l’actualité tech en temps réel : ajoutez 01net à vos sources sur Google, et abonnez-vous à notre canal WhatsApp.