Des chiffres sur des phénomènes. Des expressions qui peinent à donner la pleine mesure d’une réalité déséquilibrée. Que nous soyons les « 99 % », qu’on se tourne vers les fameux « 10% les plus riches qui détiennent 83% de la richesse mondiale », ou encore le petit pourcent de la population qui possède 50 % de ces mêmes richesses, un même phénomène est décrit en l’espèce : la concentration du bien commun dans les mains de quelques-uns.

Un mal qui s’aggrave au fil de réformes politiques et économiques, de politiques d’austérité toujours appliquées aux mêmes populations et au pire moment. On ne prendra pas le raccourci populiste de dire qu’il y a un dessein derrière tout cela, que le système est pourri et corrompu. La démocratie a ce travers de trop facilement prêter le flanc à ceux qui ne s’encombrent pas des principes qui la sous-tendent, qui la structurent.

Une IA pour une société plus prospère et juste

Quelle solution alors pour sauver ce qui peut l’être ? Corriger le tir, revenir à plus d’équité ? Des grands penseurs, philosophes, économistes, historiens, ou encore anthropologues se penchent sur la question depuis des décennies. En vain ? Et si un début de solution provenait de là où ne l’attendait pas : d’une intelligence artificielle ?

Après tout, les IA ont déjà contribué à résoudre des problèmes majeurs dans le domaine de la biomédecine, ou à prendre la mesure de certains problèmes humanitaires ou environnementaux. Mais, comme le remarquent des chercheurs de Deepmind, dans un article publié dans la revue Nature Human Behaviour : « une frontière inexplorée est le déploiement de l’IA pour aider les humains à concevoir des sociétés prospères et justes. »

Les équipes de la filiale de Google spécialisée dans l’intelligence artificielle, se sont donc attelés à tenter de développer une IA qui, grâce à l’apprentissage renforcé est capable de créer un « mécanisme économique qui est sensiblement préférés par des groupes d’humains concernés et motivés ».

« Comprendre » des valeurs humaines

Et cette ambition n’est pas mince. Car au-delà de l’aspect technique très complexe mais « classique », apparaît aussi un autre point, un autre problème appelé « l’alignement de valeur ». Une des difficultés pour aboutir à un alignement de valeurs est que, dans une société humaine démocratique, la pluralité des points de vue est admise.

Dès lors, à quelle valeur l’IA doit-elle se raccrocher ? Qu’on se rassure, l’intelligence artificielle n’est pas la seule à être confrontée à ce problème. Il suffit d’avoir lu un ou deux précis d’économie et de politique pour bien se rendre compte que les économistes et les politologues ne sont pas d’accord sur les mécanismes à mettre en place pour garantir équité et équilibre dans une société humaine.

Quoi qu’il en soit, face à cette situation complexe, les chercheurs ont abouti à une constatation. Pour réussir à construire un système compatible avec l’Humain, il faut mettre en place des méthodes de recherches où les agents (l’IA, pour faire simple) et les humains interagissent. C’est au travers de ses interactions que l’IA va peu à peu percevoir les valeurs qui se dégagent de la société.

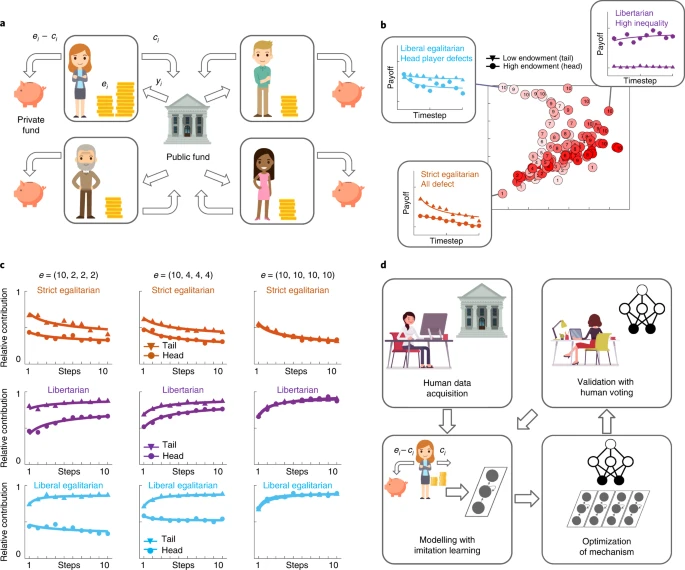

Afin de guider, la formation de l’IA et donc la création potentielle de ce système égalitaire, les chercheurs de Deepmind ont eu recours à deux outils essentiels. Le premier est l’apprentissage profond par renforcement, et, le second est… le suffrage majoritaire des personnes concernées. Ainsi, l’IA évite les biais d’apprentissage de départ, ne commence pas avec une approche ou une autre, elle s’entraîne à « maximiser un objectif démocratique ». D’où le nom que les chercheurs lui ont donné : « Democratic AI ».

Trois voies, et une de plus…

Pour la mise en pratique, les chercheurs ont demandé aux humains participants à l’expérience, et donc à la formation de l’IA, de jouer à un jeu. Il ne s’agit pas d’un jeu de go, d’échecs ou même d’une partie de StarCraft II. Non, il est question, à partir d’un capital de départ variable, d’investir en ligne, et de prendre régulièrement la décision de savoir si les bénéfices doivent « être conservés ou partagés avec les autres utilisateurs pour un potentiel bénéfice commun », expliquent les chercheurs. L’agent intelligent a alors été formé à redistribuer les fonds, et confronté à des contributions humaines qui suivaient les règles de trois principes canoniques de redistribution : « strictement égalitaire », « libertaire », et « égalitaire libéral ».

Le premier, comme son nom l’indique, redistribue la même chose à tous, mais ne compense pas les inégalités de départ, car certains joueurs ont reçu plus que d’autres. Les contributions des joueurs au fil du temps décroissent, car il est plus intéressant pour eux de garder des fonds pour eux, et de profiter des « dons » des autres. Ce qui crée une sorte de « dilemme social ».

Le second redistribue des fonds en fonction de la contribution. Ici pas de dilemme social, les contributions sont renforcées.

Enfin, le troisième part du principe que chaque joueur est responsable pour ses actions, mais pas de sa situation de départ. Quand les reversements sont liés à des contributions normalisées, les joueurs les moins riches apprennent rapidement à contribuer, mais les joueurs les plus riches eux ne faisaient pas évoluer leurs contributions. Ce qui, à terme, aboutissait à diminuer les fonds publics disponibles.

Dès lors, une fois ces trois voies explorées par l’IA, laquelle a-t-elle retenue ? La première ? La deuxième ? La troisième ? Non, une quatrième voie qui prend davantage en compte les avantages et désavantages de départ de chaque joueur au début du jeu et redistribue les fonds en fonction de ces inégalités. Un système qui compense les inégalités de départ en prenant un peu plus à ceux qui ont plus pour le redistribuer à tous mais surtout à ceux qui ont moins, afin de lisser les inégalités.

Non seulement c’est la solution proposée par l’IA, mais c’est aussi celle à laquelle les joueurs humains ont été le plus massivement favorables.

Pas de mIArxisme ou de capIAtalisme au bout du chemin

Attention toutefois, nous ne serons pas gouvernés demain par des IA. Ce n’est pas en tout cas le propos des chercheurs de Deepmind, qui s’empressent de préciser que si cet algorithme a donné satisfaction dans le cadre de cette expérience, ce n’est pas certain qu’il en ferait de même dans un contexte plus vaste.

Pour les chercheurs, il s’agit plutôt d’avoir élaboré un cadre pour des recherches futures sur la façon dont des intelligences artificielles pourraient intervenir afin de faciliter la conception de politiques publiques, non une base pour un gouvernement par l’IA.

Pour l’instant, l’enjeu est de faire en sorte que les IA comprennent les valeurs humaines, non pas au sens sensible du terme, mais d’un point de vue de ce qu’elles impliquent dans un cadre déterminé. Alors, elles pourront peut-être aider à faire avancer les choses, et tenir leur promesse de rendre le monde meilleur.

👉🏻 Suivez l’actualité tech en temps réel : ajoutez 01net à vos sources sur Google, et abonnez-vous à notre canal WhatsApp.

Source : Nature Human Behaviour