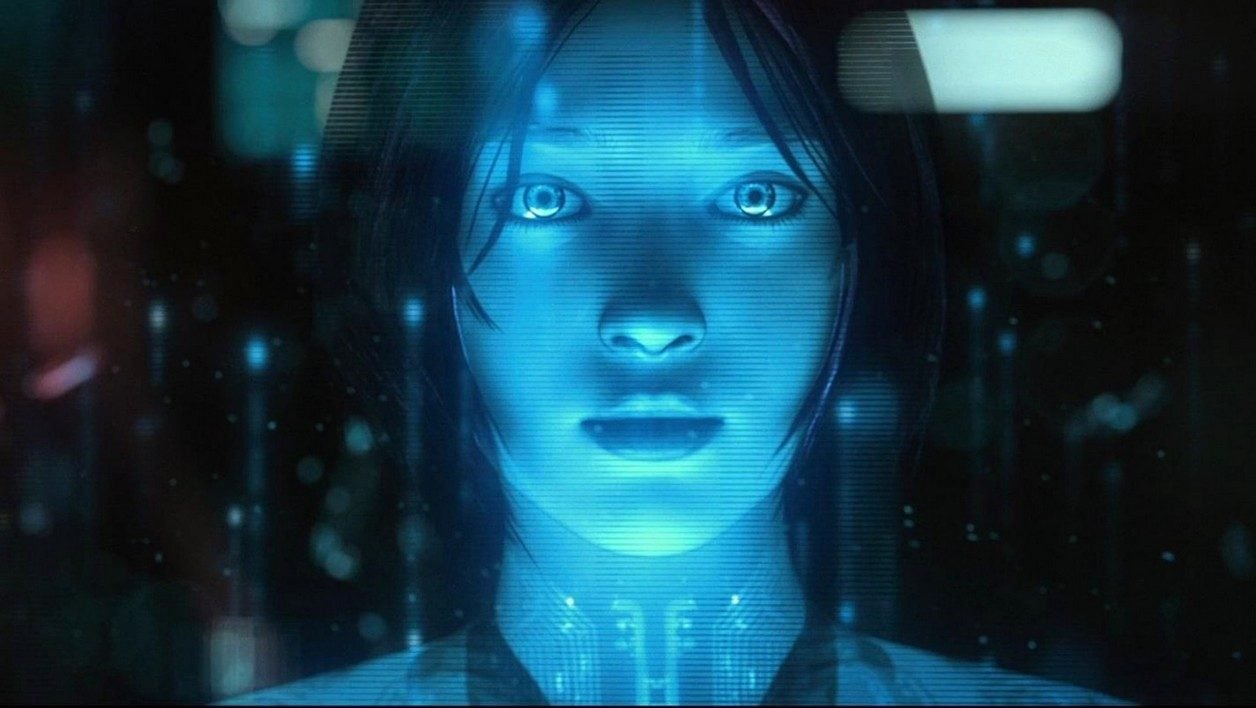

Le robot humanoïde Sophia a fait la une des médias américains durant le CES. A quelques notables exceptions, il était mis en valeur dans des interviews où ses hésitations et ses silences étaient coupés au montage. Ce qui a laissé croire à une conversation fluide entre l’homme et la machine. De quoi exaspérer Yann LeCun, directeur de FAIR, la section de recherche en intelligence artificielle chez Facebook. L’éminent spécialiste a dénoncé des démonstrations complètement « bullshit » sur les réseaux sociaux.

More BS from the (human) puppeteers behind Sophia.

Many of the comments would be fun if they didn't reveal the… https://t.co/izvyMGLV8p

— Yann LeCun (@ylecun) January 17, 2018

« Cela contribue à entretenir un buzz dangereux autour de l’IA, et crée des attentes totalement irréalistes dans le public et dans les médias sur l’état de l’art en intelligence artificielle. C’est malhonnête et destructeur », a-t-il aussi écrit.

Regarder du côté des sciences cognitives

De passage à Paris pour plusieurs conférences ouvertes au public, il a dressé l’état de l’art en matière d’intelligence artificielle. Et selon lui, on est encore très loin de pouvoir égaler l’homme. « Les meilleurs systèmes d’intelligence artificielle ont moins de sens commun qu’un rat » a-t-il déclaré de façon abrupt pour couper court d’emblée au fantasme du film Her dans lequel le héros tombe amoureux d’une séduisante IA.

Les machines seraient encore très en-dessous de nos capacités biologiques. « Les humains et les animaux construisent des modèles de prédiction qui leur permettent d’apprendre sans faire trop de bêtises, par observation et interaction et à partir de très peu d’exemples ». L’homme n’a ainsi pas besoin de rentrer dans une voiture dans un platane ou de tomber d’une falaise pour comprendre que c’est dangereux : il sait à l’avance ce qui va se passer.

A l’inverse, les systèmes d’intelligence artificielle ont, eux, besoin d’être énormément entraînés comme AlphaGo de Google qui a battu les meilleurs champions de Go. C’est la raison pour laquelle Facebook regarde plus loin que les mathématiques et collabore avec des chercheurs comme Emmanuel Dupoux, spécialiste en psycholinguistique à l’ENS.

Ce dernier étudie notamment les capacités d’apprentissage humaines pour en tirer des modèles de cognition. Un bébé apprend très vite des concepts de direction, de position ou de permanence des objets. « Le sens commun représente une quantité de savoir gigantesque acquis très vite durant les premiers moments de la vie. Si l’on pouvait permettre aux machines d’apprendre aussi vite ces méthodes, on effectuerait de très gros progrès en matière d’intelligence artificielle », renchérit Yann LeCun.

Communiquer avec les IA autrement que par le dialogue

Même pragmatisme du côté d’Antoine Bordes, qui dirige le laboratoire FAIR à Paris et l’un des artisans de Facebook M, une expérimentation qui visait à intégrer un assistant personnel à Facebook Messenger.

Ce bot devait être capable de répondre aux questions des internautes formulées en langage naturel. « On est parti de ce que voudraient les gens idéalement. On pensait être capable d’automatiser davantage de tâches mais cela s’est avéré plus compliqué que prévu parce que les besoins exprimés étaient infinis et très personnalisés », nous explique simplement Antoine Bordes.

Les chercheurs de Facebook ont aussi beaucoup observé les agents conversationnels. Leur constat est sans appel. Il est impossible de tenir une conversation intéressante qui dure plus de deux minutes avec un robot. Les modèles parviennent à initier la conversation avec des formules comme « Bonjour ! Comment allez-vous ? » et peuvent même artificiellement la prolonger en vous relançant sur votre sport préféré mais demeurent incapables de réagir dès que le cours du dialogue devient unique. « L’homme est capable de sauter du coq à l’âne, d’établir des connexions. Le modèle, lui, va être perdu parce qu’il va sans cesse se retrouver dans des problématiques qu’il n’a jamais rencontrées », nous détaille encore Antoine Bordes.

Si le défi du dialogue n’est pas prêt d’être résolu, cela ne mettra pas forcément un frein au développement des assistants vocaux. Pour les équipes de FAIR, les internautes sont déjà habitués à interagir avec des moteurs de recherche et savent sélectionner les bons mots clefs pour lancer des requêtes. Il ne s’agira pas forcément d’échanger avec un robot comme avec un semblable mais de développer un mode de communication efficace pour obtenir l’accomplissement d’une tâche utile. Comme dire « lumière salon ! » à votre enceinte intelligente plutôt que « s’il te plaît pourrais-tu allumer la lumière dans le salon ? ». Avec dans le futur, le développement probable d’usages encore aujourd’hui insoupçonnés.

Combiner différentes méthodes

Pionnier du deep learning, qui consiste à apprendre à des réseaux de neurones artificiels à effectuer certaines tâches, Yann LeCun semble pourtant déjà passé à autre chose.

Conscient des limites de cet apprentissage profond, il cherche maintenant à faire progresser encore davantage l’intelligence artificielle. Les pistes sont nombreuses comme expérimenter de nouvelles structures de réseaux de neurones ou encore optimiser les méthodes mathématiques.

Mais pour lui, la clef semble se trouver dans ce qu’il appelle la « programmation différentielle » et que d’autres appellent aussi système d’apprentissage hybride neuro-symbolique. Il s’agit de combiner différentes méthodes : à la fois du deep learning et une mémoire, ou encore de l’apprentissage par renforcement non supervisé et de la programmation, du dynamique et du statique. « Peut-être que certaines tâches ne peuvent être apprises. D’où l’intérêt de mixer des parties qui pourraient être apprises avec d’autres codées ou stockées dans une mémoire », nous éclaire Antoine Bordes.

L’espoir de Yann LeCun, c’est que l’intelligence artificielle progresse de cette manière de façon conséquente dans les années à venir. Si ce n’est pas le cas, il craint un nouvel hiver pour cette discipline qui a connu bien des hauts et des bas depuis les années cinquante. « Le pari est de savoir si les gens vont continuer à y croire, alors que les résultats ne correspondent toujours pas à ce qu’ils ont rêvé», s’interroge-t-il.

👉🏻 Suivez l’actualité tech en temps réel : ajoutez 01net à vos sources sur Google, et abonnez-vous à notre canal WhatsApp.