Amazon ne se contente pas d’être un géant du e-commerce ou de l’hébergement dans le cloud. Il a aussi développé un logiciel d’analyse intelligente des images ouvert à tous, Rekognition, utilisé notamment par des services de police et des agences gouvernementales américaines pour identifier et traquer des personnes filmées par des caméras de vidéosurveillance. La fonction de reconnaissance faciale de ce système fait aujourd’hui l’objet d’une intense controverse aux Etats-Unis.

Les politiciens de couleur sur-représentés

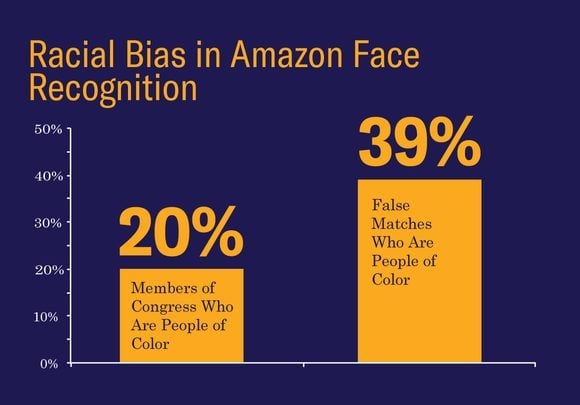

Il est en effet accusé par l’ACLU (American Civil Liberties Union) de ne pas être fiable. Cette dernière a soumis les photos de tous les membres du Congrès à Rekognition, en les comparant à une base de données de criminels. Et surprise, le logiciel a établi à tort 28 correspondances. Les représentants américains identifiés abusivement sont aussi bien des hommes que des femmes, des Républicains que des Démocrates, de tous âges et de toutes les régions des Etats-Unis. En revanche, les personnes de couleur, qui ne représentent que 20% des membres du Congrès, apparaissent dans 40% des résultats.

Pour l’ACLU, la conclusion est évidente : le logiciel reconnaît moins bien les hommes de couleur que les blancs et se trouve donc biaisé. Etant donné les conséquences graves sur la vie de personnes qui pourraient être ainsi faussement suspectées, elle demande qu’un moratoire soit prononcé sur l’utilisation de la reconnaissance faciale par les forces de l’ordre. Elle cite comme exemple un cas en Oregon où Amazon Rekognition est déjà exploité pour comparer les visages des gens à une base de données de photos de police judiciaire, sans avoir suscité préalablement de débat public.

« Cette technologie ne devrait pas être utilisée avant que les préjudices ne soient pleinement pris en compte et que toutes les mesures nécessaires soient prises pour les empêcher de nuire aux communautés vulnérables », peut-on lire sur le site officiel de l’association.

Rekognition doit être utilisé avec un taux d’exactitude de 99%

La réponse d’Amazon n’a pas tardé. La société reproche globalement à l’ACLU de ne pas avoir donné de détails sur les dessous de son expérimentation. Plus particulièrement, elle souligne que les correspondances montées en épingle ne seraient que des faux positifs obtenus avec de mauvais paramètres. Le taux de fiabilité demandé n’était en effet que de 80%. Acceptable pour reconnaître une célébrité ou un membre de la famille dans les photos d’une application. Mais Amazon recommande de ne prendre en compte que les taux d’exactitude de 99% lorsqu’il s’agit d’identifier quelqu’un dans les situations sensibles. En reproduisant le test de l’ACLU et ne se basant sur ce taux de 99%, Amazon prétend n’avoir eu à déplorer aucune erreur. Mais il n’apporte aucune preuve de cette contre-enquête.

Par ailleurs, le groupe souligne que son logiciel n’est qu’une aide à la décision et ne constitue en rien une preuve ultime. C’est toujours à l’humain qui s’en sert de faire ensuite des choix. La société regrette enfin de ne pas en savoir davantage sur la base de données de comparaison utilisée par l’ACLU, cette dernière pouvant être faussée et avoir entraîné ces réponses erronées. Amazon conclut en rappelant qu’il améliore sans cesse son système et que les machines restent le meilleur moyen d’identifier une personne, la fiabilité de témoins oculaires étant plus faible que celle des logiciels.

Aux arguments d’Amazon, on opposera une première remarque. Rien n’oblige pour le moment un utilisateur à se servir du logiciel en poussant aussi loin le taux de fiabilité. C’est peut-être ce à quoi fait allusion l’entreprise avec ce passage énigmatique à la fin de sa communication. « Nous ne devrions pas jeter le four parce que la température pourrait être mal réglée et brûler la pizza. Cependant, il serait raisonnable que le gouvernement intervienne et précise la température (ou les niveaux de confiance) que les organismes d’application de la loi doivent respecter pour accomplir leur travail de sécurité ». Amazon qui en appelle à l’intervention du gouvernement, voilà qui n’est pas commun.

Les hommes blancs sont mieux reconnus

Cela ne changera toutefois pas un problème plus fondamental. Au mois de février dernier, une étude du MIT Media Lab a prouvé que la reconnaissance faciale était beaucoup plus efficace sur les hommes blancs, en testant les outils de Microsoft, Google, Face ++ et IBM. Tout simplement parce que les ordinateurs ont été entraînés depuis davantage à reconnaître des hommes blancs plutôt que des femmes ou des noirs. Les bases de données d’apprentissage étaient biaisées, et aujourd’hui les performances des logiciels s’en trouvent entachées. On attend donc maintenant une étude académique plus rigoureuse sur Rekognition, afin de vérifier qu’il ne produit pas des résultats orientés sans le savoir.

Ce n’est pas la première fois que ce logiciel est l’objet d’une polémique. Au mois de juin dernier, des salariés avaient adressé une pétition à Jeff Bezos, indignés que les services de cloud d’AWS et que ce fameux outil de reconnaissance faciale puissent être utilisés par l’administration Trump pour traquer indirectement des migrants. Des actionnaires et des associations de droits civiques réclament également qu’Amazon cesse de faire affaire pour ces raisons avec le gouvernement.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.